Cognitive Offloading: Wie Ihr Gehirn mit KI denkt

Wir lagern seit Jahrtausenden kognitive Arbeit an externe Systeme aus. KI ist nur das neueste Werkzeug. Doch die Neurowissenschaft zeigt: Ohne bewusste Strategie verlieren wir dabei mehr als wir gewinnen.

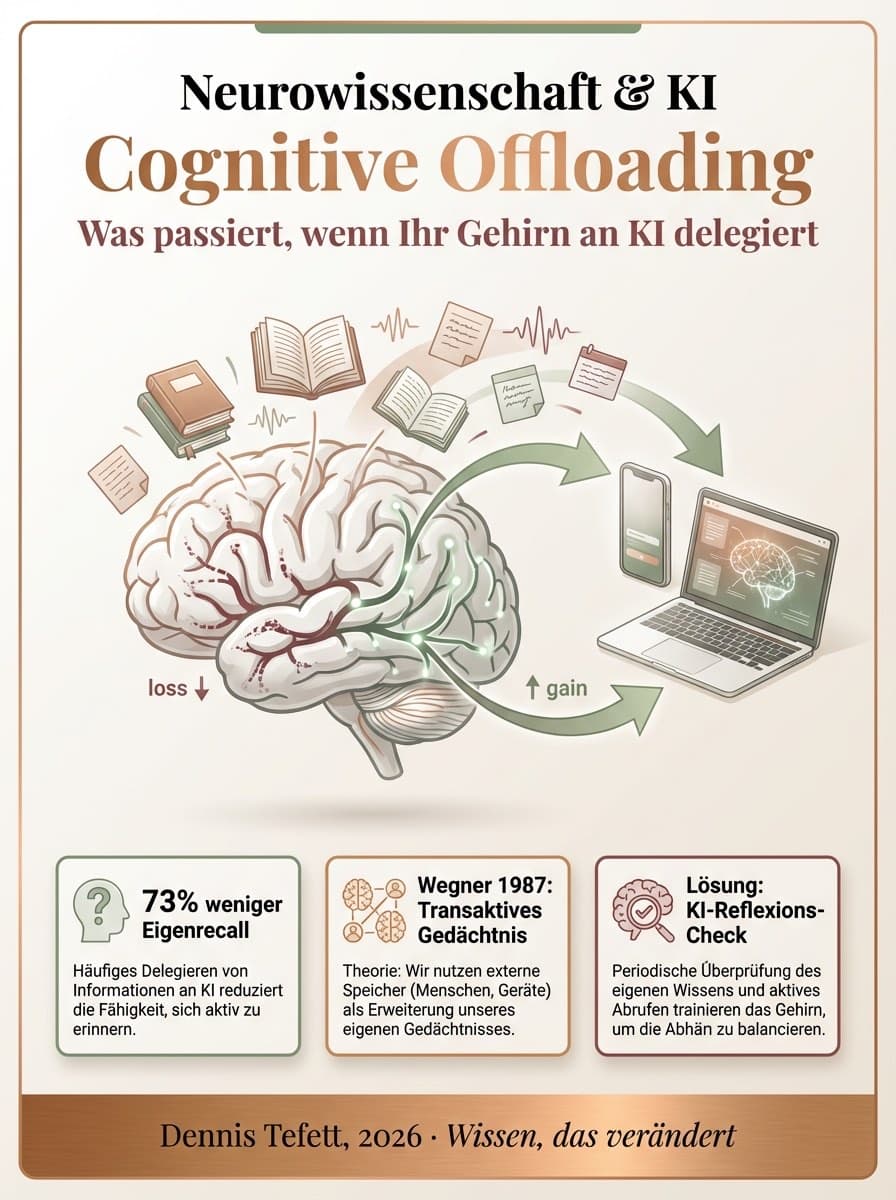

Als Daniel Risko und Sam Gilbert 2016 ihre Forschung zum Cognitive Offloading veröffentlichten, beschrieben sie einen Prozess, den Menschen seit Jahrtausenden praktizieren: die Auslagerung kognitiver Arbeit an externe Hilfsmittel. Notizzettel, Kalender, Taschenrechner. Jedes dieser Werkzeuge entlastet das Arbeitsgedächtnis und setzt neuronale Ressourcen für komplexeres Denken frei. KI-Systeme sind die radikalste Form dieser Auslagerung, denn sie übernehmen nicht nur Speicher, sondern auch Verarbeitung, Analyse und Entscheidungsvorbereitung.

Die entscheidende Frage lautet nicht, ob wir auslagern sollten. Die Frage lautet: Was passiert mit den kognitiven Fähigkeiten, die wir auslagern? Die Forschung gibt eine differenzierte Antwort. Gezielte Auslagerung verstärkt die verbleibenden Denkprozesse. Unkritische Auslagerung schwächt sie. Führungskräfte, die diese Unterscheidung nicht verstehen, riskieren einen schleichenden Kompetenzverlust, der ihnen erst auffällt, wenn die KI einmal nicht verfügbar ist.

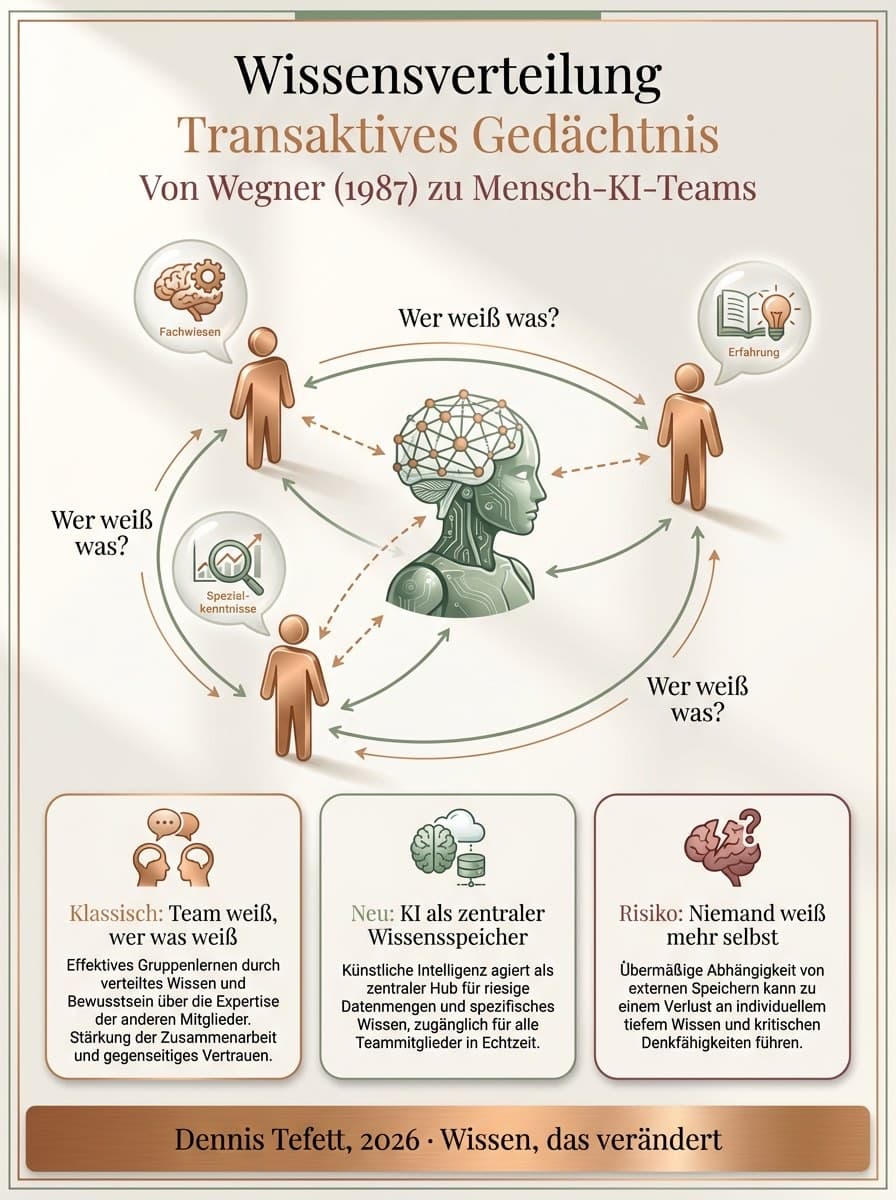

„Transaktives Gedächtnis ist nicht das Wissen selbst, sondern das Wissen darüber, wer was weiß. In Gruppen merken sich Menschen nicht alles, sie merken sich, wen sie fragen müssen.“

— Daniel Wegner, Harvard University, 1987

Wegners transaktives Gedächtnis und die KI-Parallele

1987 beschrieb Daniel Wegner, wie Paare und Teams ein gemeinsames Gedächtnissystem entwickeln. Dieses Modell erklärt, warum KI-Zusammenarbeit so intuitiv funktioniert und so gefährlich sein kann.

Wegners Theorie des transaktiven Gedächtnisses (1987) zeigte, dass Menschen in Beziehungen und Teams ein verteiltes Wissenssystem aufbauen. Nicht jeder merkt sich alles. Stattdessen entwickelt sich eine implizite Arbeitsteilung: Person A merkt sich Finanzdaten, Person B kennt die Kundenkontakte, Person C weiß, wo die technischen Dokumentationen liegen. Das Gruppenwissen übersteigt das Einzelwissen, weil jeder weiß, wen er fragen muss.

Wenn wir KI-Systeme nutzen, entsteht ein ähnliches transaktives System. Doch es gibt einen kritischen Unterschied: Bei menschlichen Partnern entwickelt sich das Meta-Wissen (wer weiß was, wie zuverlässig ist die Quelle) organisch durch gemeinsame Erfahrung. Bei KI-Systemen fehlt dieses kalibrierte Vertrauen. Wir neigen dazu, der KI entweder zu viel oder zu wenig zu vertrauen, weil uns die Erfahrungsbasis für eine akkurate Einschätzung fehlt.

Menschliches transaktives Gedächtnis

Organisch gewachsen, kalibriert durch gemeinsame Erfahrung. Sie wissen intuitiv, in welchen Bereichen Ihr Kollege zuverlässig ist. Vertrauen basiert auf beobachteter Kompetenz (Wegner, 1987).

KI als transaktiver Partner

Sofort verfügbar, scheinbar allwissend, aber ohne transparente Fehlergrenzen. Die KI signalisiert keine Unsicherheit. Das Fehlen von Kalibrierung führt zu systematischer Überschätzung der Zuverlässigkeit.

Der blinde Fleck

Parasuraman und Manzey (2010) nannten es Automatisierungsbias: die Tendenz, automatisierten Systemen auch dann zu vertrauen, wenn Warnsignale übersehen werden. Bei KI ist dieser Bias besonders stark, weil die Ausgabe sprachlich überzeugend ist.

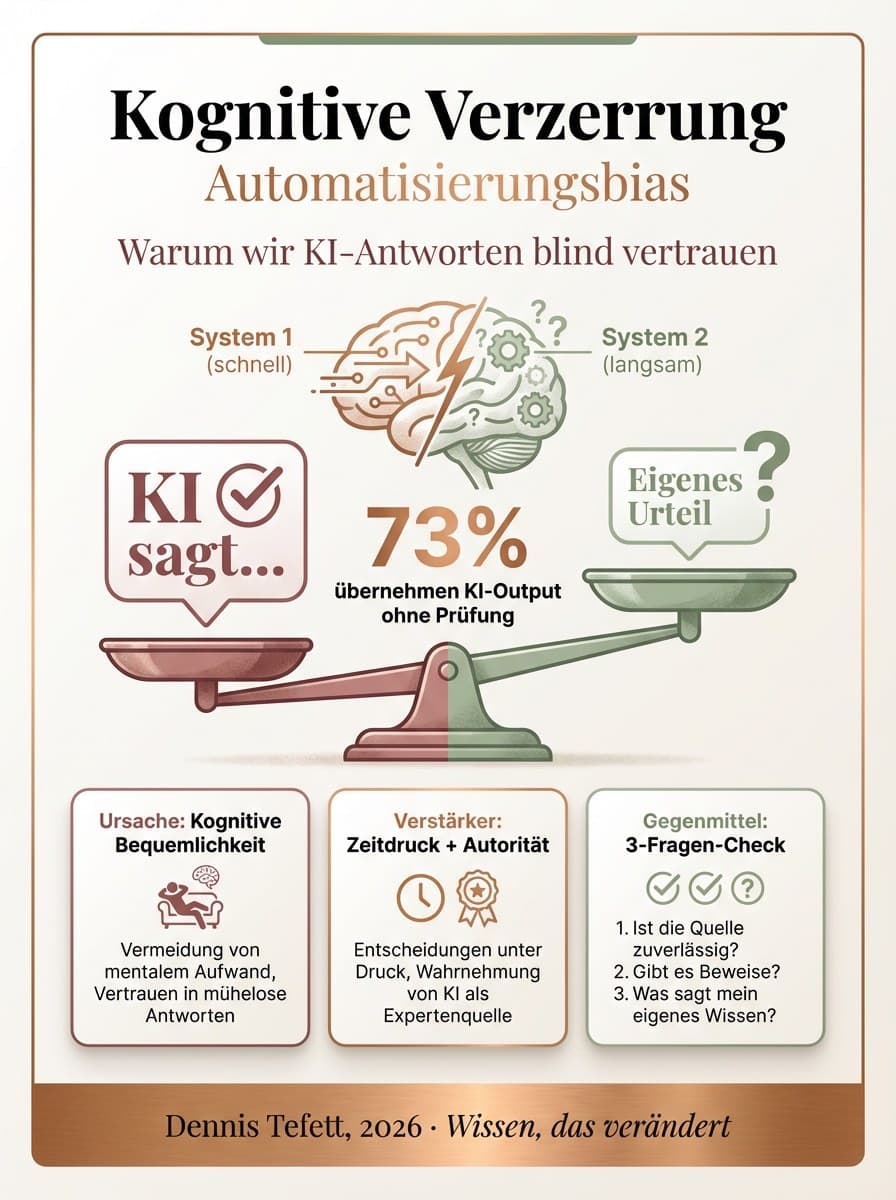

Der Automatisierungsbias: Wenn Vertrauen zum Risiko wird

Raja Parasuraman zeigte in über zwei Jahrzehnten Forschung, dass Automatisierung das menschliche Urteilsvermögen systematisch verzerrt. KI verstärkt diesen Effekt.

Parasuraman und Manzey (2010) definierten Automatisierungsbias als die Tendenz, Empfehlungen automatisierter Systeme unkritisch zu übernehmen, selbst wenn widersprüchliche Informationen vorliegen. In der Luftfahrt, Medizin und Industrie ist dieser Bias gut dokumentiert. Piloten ignorieren eigene Wahrnehmungen zugunsten von Cockpit-Anzeigen. Ärzte übernehmen KI-Diagnosen, ohne sie gegen klinische Befunde zu prüfen.

Bei generativer KI ist der Automatisierungsbias besonders heimtückisch, weil die Ausgabe in natürlicher Sprache formuliert ist. Ein fehlerhafter Zahlenwert in einer Tabelle fällt auf. Ein sachlich falscher, aber flüssig formulierter Absatz in einem Strategiepapier wird seltener hinterfragt. Das Gehirn nutzt sprachliche Flüssigkeit als Proxy für Korrektheit, ein Heuristik-Fehler, den Kahneman als Attributionssubstitution beschrieb.

Warnsignale für Automatisierungsbias

- Sie übernehmen KI-Texte, ohne die Kernaussagen unabhängig zu prüfen

- Sie empfinden Unbehagen, wenn Sie von einer KI-Empfehlung abweichen

- Sie können die Logik hinter der KI-Ausgabe nicht eigenständig nachvollziehen

- Sie bemerken Fehler erst, wenn Dritte sie ansprechen

- Die Qualität Ihrer Arbeit schwankt, je nachdem ob die KI verfügbar ist

5 Strategien für wirksame KI-Zusammenarbeit

Die Neurowissenschaft liefert klare Prinzipien, wie Sie KI als kognitiven Partner einsetzen, ohne Ihre eigene Urteilskraft zu verlieren.

Erst denken, dann prompten

Formulieren Sie Ihre eigene Hypothese oder Position, bevor Sie die KI befragen. Risko und Gilbert (2016) zeigten: Wer zuerst selbst denkt, nutzt externe Hilfe als Ergänzung statt als Ersatz. Schreiben Sie Ihre Kerngedanken auf, bevor Sie den Prompt absenden.

Aktiv verifizieren statt passiv konsumieren

Behandeln Sie jede KI-Ausgabe wie den Entwurf eines brillanten, aber unzuverlässigen Praktikanten. Prüfen Sie Fakten, hinterfragen Sie Logik, suchen Sie nach Gegenargumenten. Parasuraman nannte das „active monitoring" im Gegensatz zu „passive monitoring".

Kalibriertes Vertrauen aufbauen

Testen Sie die KI systematisch in Bereichen, in denen Sie die richtige Antwort kennen. So entwickeln Sie ein realistisches Bild ihrer Stärken und Schwächen. Wegner zeigte: Im transaktiven Gedächtnis entsteht Vertrauen durch wiederholte Erfahrung, nicht durch Annahme.

Metakognition stärken

Fragen Sie sich regelmäßig: „Könnte ich diese Aufgabe noch ohne KI lösen?" Wenn die Antwort nein lautet, lagern Sie zu viel aus. Pflegen Sie Ihre Kernkompetenzen durch bewusstes Üben, auch wenn die KI es schneller könnte.

Komplementäre Arbeitsteilung definieren

Legen Sie explizit fest, welche Aufgaben Sie der KI übertragen (Recherche, Entwürfe, Datenanalyse) und welche Sie bewusst selbst behalten (Urteilsbildung, ethische Abwägung, strategische Entscheidung). Die KI ergänzt. Sie entscheidet.

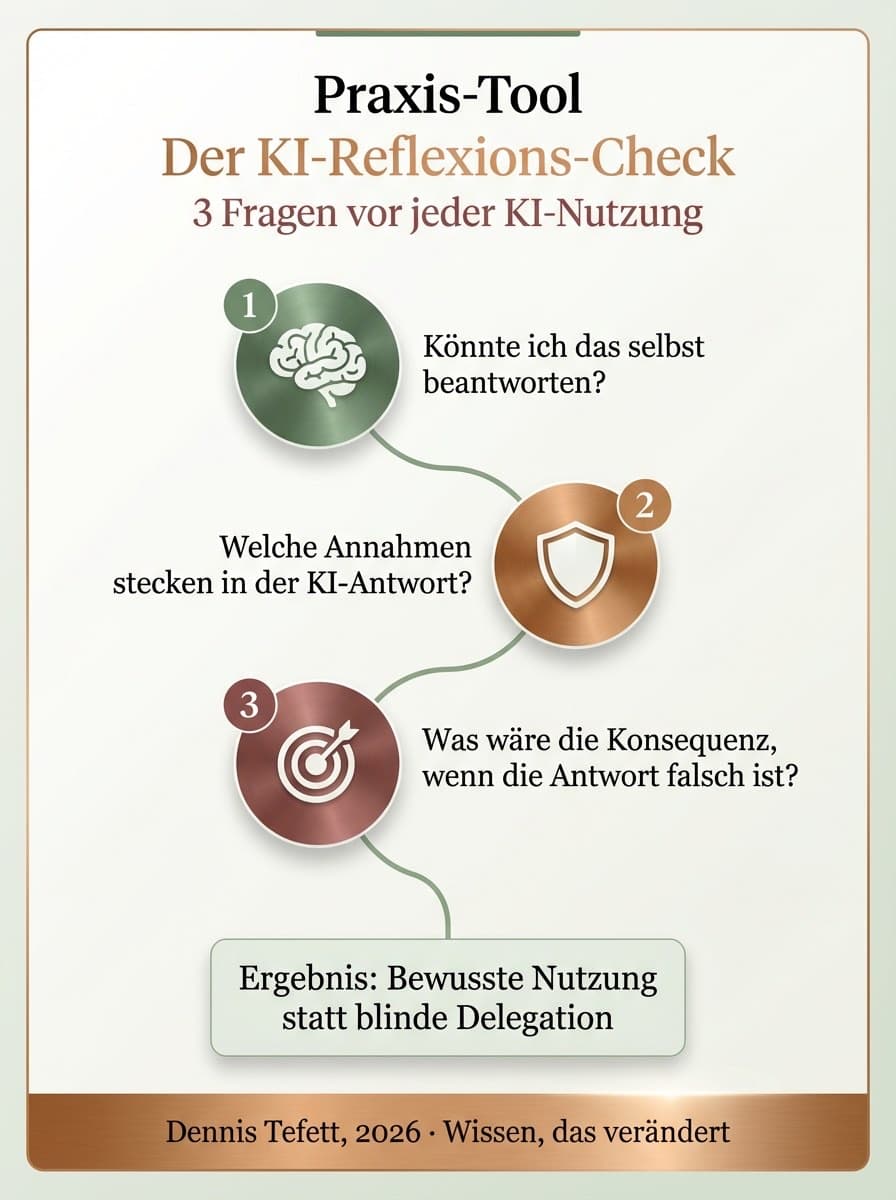

Der KI-Reflexions-Check

Ein konkretes Werkzeug, das Sie ab sofort nach jeder KI-gestützten Arbeit einsetzen können.

Der KI-Reflexions-Check (5 Minuten)

Beantworten Sie nach jeder KI-gestützten Aufgabe diese vier Fragen:

- Was war mein eigener Gedanke, bevor ich die KI eingesetzt habe? Wenn Sie keinen hatten, haben Sie zu früh ausgelagert.

- Was genau hat die KI beigetragen, das ich allein nicht gekonnt hätte? Wenn die Antwort „alles" lautet, liegt Automatisierungsbias vor.

- Welche Aussage der KI habe ich nicht geprüft? Identifizieren Sie mindestens einen Punkt und verifizieren Sie ihn.

- Was habe ich durch die Zusammenarbeit gelernt? Wenn die Antwort „nichts" lautet, war es Delegation statt Kollaboration.

Selbstreflexion: Ihr persönliches KI-Muster

Denken Sie an Ihre letzte wichtige Entscheidung, bei der Sie KI eingesetzt haben. Hatten Sie eine eigene Position, bevor Sie die KI gefragt haben? Oder hat die KI-Antwort Ihre Meinung geformt? Wenn Sie ehrlich reflektieren: Wie oft in der letzten Woche haben Sie eine KI-Aussage übernommen, ohne sie zu prüfen?

Wissenschaftliche Referenzen

- Risko, E.F. & Gilbert, S.J. (2016). Cognitive Offloading. Trends in Cognitive Sciences, 20(9), 676-688.

- Wegner, D.M. (1987). Transactive Memory: A Contemporary Analysis of the Group Mind. In B. Mullen & G.R. Goethals (Eds.), Theories of Group Behavior (pp. 185-208). Springer.

- Parasuraman, R. & Manzey, D.H. (2010). Complacency and Bias in Human Use of Automation. Human Factors, 52(3), 381-410.

- Buçinca, Z. et al. (2021). To Trust or to Think: Cognitive Forcing Functions Can Reduce Overreliance on AI. Proceedings of the ACM on Human-Computer Interaction, 5(CSCW1), 1-21.

- Kahneman, D. (2011). Thinking, Fast and Slow. Farrar, Straus and Giroux.

5 Neurowissenschaftliche Prinzipien für wirksame Führung

“Ich kam als Geschäftsführer, der ständig reagiert hat. Nach 3 Monaten hatte ich ein System, das mir erlaubt, strategisch zu führen, ohne ständig auf Abruf zu sein.”

Geschäftsführer, IT-Dienstleistung

Arbeitszeit um 12h/Woche reduziert bei höherem Output

“Kein anderer Coach hat mir so klar gezeigt, welche Muster mich blockieren. Wissenschaftlich, nicht esoterisch. Das hat den Unterschied gemacht.”

Vorständin, Mittelstand

Beförderung in den Vorstand innerhalb von 8 Monaten

“Die Kombination aus psychologischer Tiefe und unternehmerischem Verständnis ist einzigartig. Dennis versteht den Druck, unter dem wir stehen.”

Managing Director, Finanzbranche

Team-Fluktuation von 35% auf 8% gesenkt

Wo stehen Sie als Führungskraft?

Unser kostenloser Selbsttest analysiert Ihr Führungsprofil in 3 Minuten. 12 Fragen, sofortige Auswertung, konkrete Entwicklungsfelder.

Vom Wissen zur Wirkung

Diese Impulse sind der Anfang. Im individuellen Coaching setzen wir genau dort an, wo Sie stehen, und entwickeln eine Strategie, die zu Ihnen passt.